文章首发于# Chevereto V4 的进阶使用:加入图片审核及儿童色情鉴黄机制, 转载请注明出处。

Chevereto V4 是一个非常出色的图片分享和存储平台,它提供了一个简洁易用的界面和强大的功能。然而,如何确保分享的图片内容的安全性和合法性,是一个严肃的问题。所以,为了能够让各位站长避免自己的图床因为别有用心的人上传一些违反公共道德及法律的图片而收到制裁,我们需要引入一个有效的图片审核及儿童色情内容的鉴黄机制。本篇博客将详细介绍如何在 Chevereto V4 中加入图片审核和儿童色情鉴黄机制。

一、图片审核#

-

启用图片审核

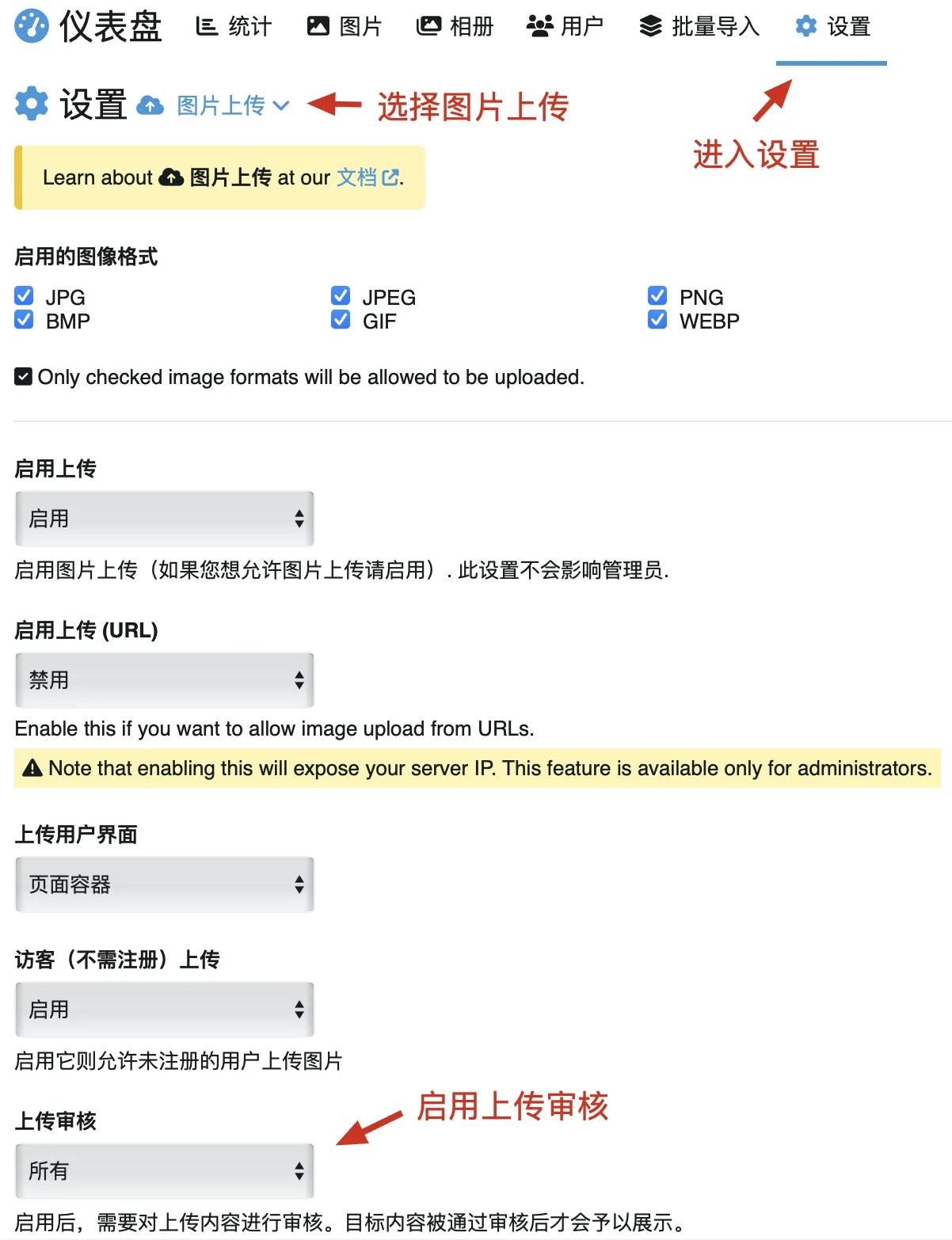

首先,我们需要在 Chevereto 的后台管理系统中启用图片审核功能。这可以在

设置->图片上传中找到。启用后,所有上传的图片在发布前都需要经过管理员的手动审核。 -

图片审核流程

当用户上传图片后,这些图片将会出现在 "待审核" 的列表中。管理员可以查看这些图片,然后选择通过或者拒绝。如果图片被拒绝,系统将会自动删除该图片,并向上传者发送通知。

二、儿童色情鉴黄机制#

对于儿童色情内容的检测,我们需要借助一些 AI 工具,这里我们就可以用到 Chevereto V4 内建由 ModerateContent提供的儿童色情鉴黄 API。

-

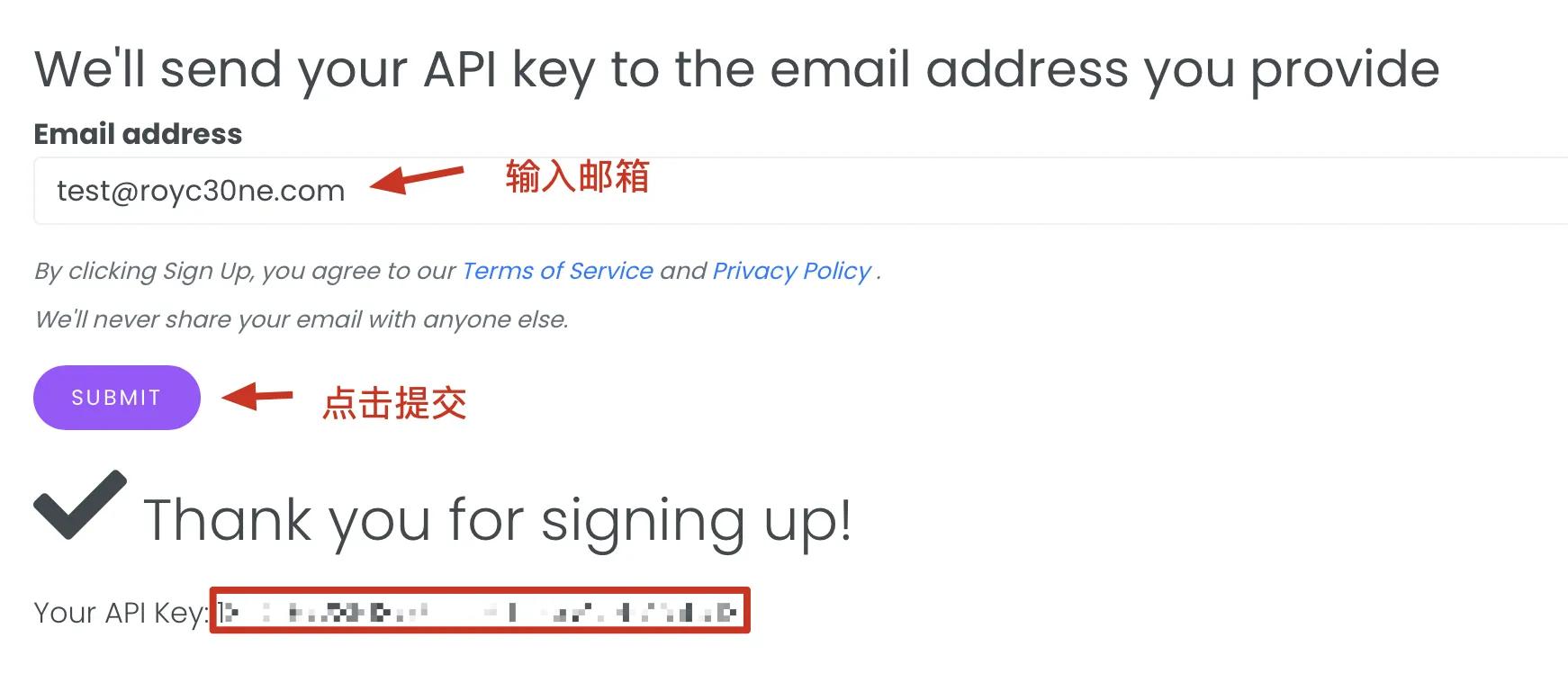

启用 AI 工具

ModerateContent 已经提供了 RESTful API,并将其集成到 Chevereto 中。首先,我们需要在这里获取一个免费的 API Key。

-

配置检测参数

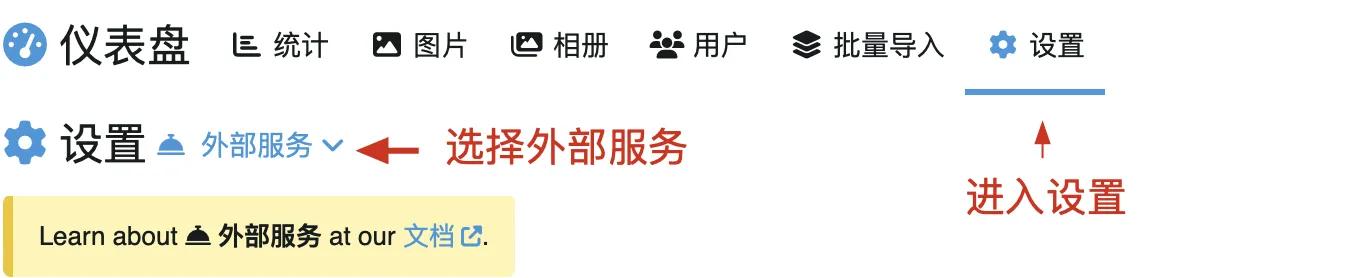

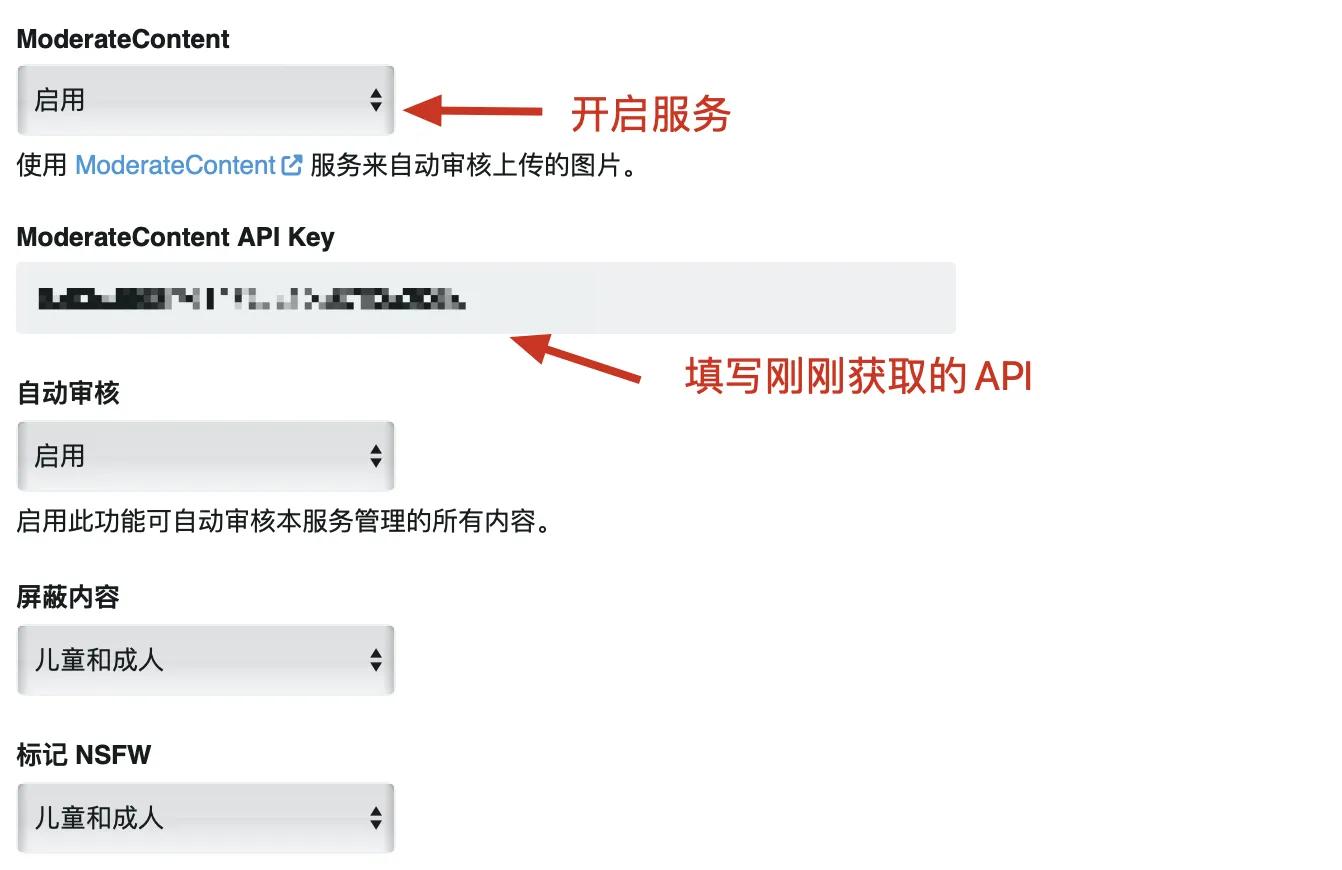

然后,在 Chevereto 的后台管理系统中,找到设置 -> 外部服务。

开启 ModerateContent 并且输入我们刚才获取的 API Key,就大功告成了。

-

自动检测流程

当用户上传图片时,系统会自动调用 AI 工具进行检测。如果检测到儿童色情内容,系统将会自动拒绝该图片,并向上传者发送通知。

注意#

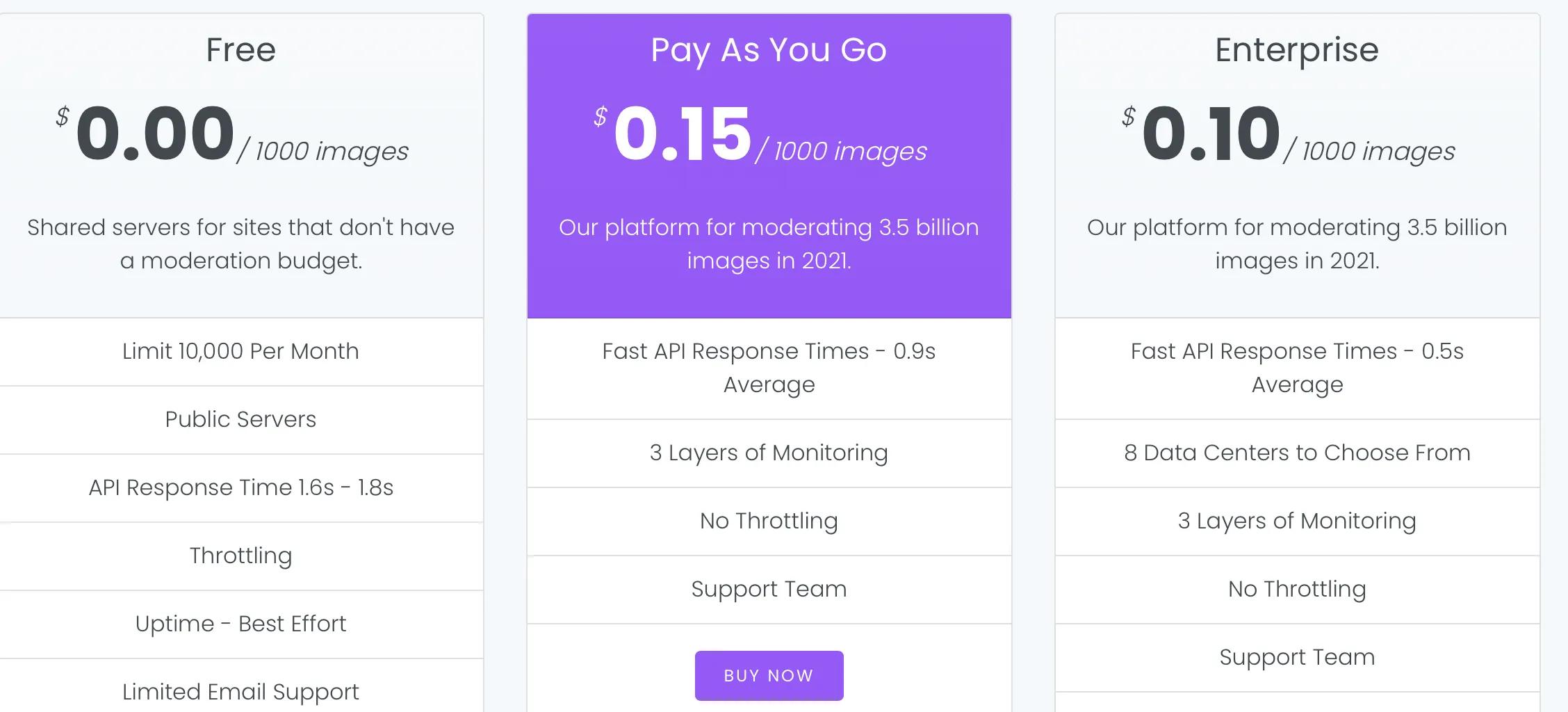

ModerateContent 的免费试用每月仅限 10000 张,如果有更多需求的话需要提升到 Pay As You Go。详细的自费可以见如下图示。

小结#

通过以上步骤,我们就可以在 Chevereto V4 中加入图片审核和儿童色情鉴黄机制了。这样可以有效地保护用户的权益,防止不适宜的内容传播。然而,这样的机制并不能完全替代人的判断,因此管理员仍然需要定期对系统的判断进行复查。

这是一个复杂但重要的过程,我们必须始终保持警惕,以确保我们的网络空间安全、健康。我们也期待更多的技术和工具能够帮助我们更有效地管理和审核图片内容,实现真正的智能化、自动化。

更多常见问题#

1. 如何处理误判的情况?

当 AI 工具误判时,可以通过人工复查来纠正。如果发现某个工具的误判率较高,可以考虑调整其配置参数,或者更换其他更精确的 AI 工具。

2. 如何防止恶意用户反复上传不适宜的图片?

可以在用户管理系统中添加限制,比如上传图片的频率限制、一次上传图片数量的限制等。对于频繁上传不适宜图片的用户,可以进行警告、禁言或者封号等处理。

3. 如果用户对审核结果有异议,应该如何处理?

可以设立一个申诉机制,用户可以通过申诉来反馈他们对审核结果的异议。管理员收到申诉后,应该再次对相关图片进行审查,并给出合理的回复。